Priorytetowe traktowanie podejścia zorientowanego na bezpieczeństwo oraz solidne zarządzanie danymi mogą pomóc organizacjom w wykorzystaniu potencjału AI przy jednoczesnym zabezpieczeniu wrażliwych informacji.

Impuls do włączania generatywnej sztucznej inteligencji (GenAI) w procesy biznesowe organizacji bez pełnego rozważenia potencjalnych konsekwencji dla bezpieczeństwa rośnie w alarmującym tempie. W miarę jak coraz więcej pracowników korzysta z AI w pracy, wzrasta prawdopodobieństwo wycieku poufnych danych o ich firmie i klientach.

Odpowiedzialne korzystanie z AI nie musi odbywać się kosztem efektywności czy innowacji. Podkreślenie podejścia zorientowanego na bezpieczeństwo przy wdrażaniu AI zwiększy ogólną skuteczność organizacji publicznych i prywatnych oraz pomoże im wyprzedzić konkurencję.

Czytaj też: Co zespoły technologiczne muszą wiedzieć o WebAssembly

Wycieki danych i ewoluujące zagrożenia

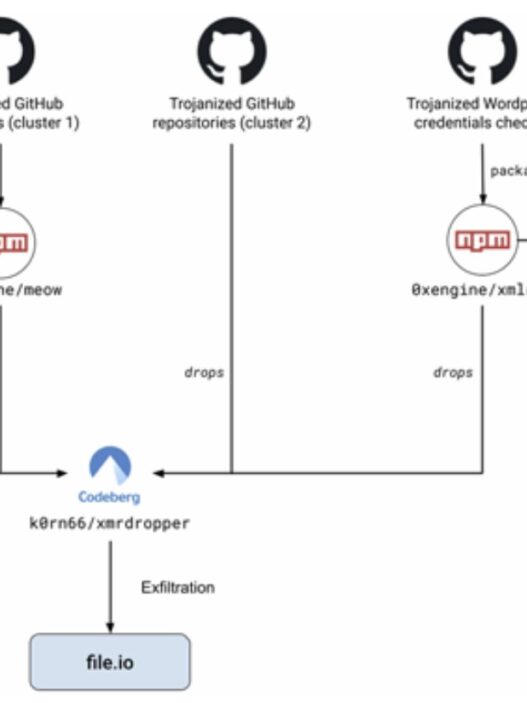

Według badania IBM Institute for Business Value, „96% kadry kierowniczej twierdzi, że przyjęcie generatywnej AI sprawia, że naruszenie bezpieczeństwa w ich organizacji jest prawdopodobne w ciągu najbliższych trzech lat.” Ryzyko takiego naruszenia można zminimalizować dzięki sprawdzonym praktykom bezpieczeństwa, takim jak ustanawianie granic bezpieczeństwa, śledzenie przepływów danych i stosowanie zasady najmniejszych uprawnień. Poza tradycyjnymi zagrożeniami bezpieczeństwa, nowe metody eksfiltracji danych ewoluują wraz z pojawieniem się AI.

Dzięki zapamiętywaniu danych, duże modele językowe (LLM) zapamiętują fragmenty danych treningowych, które mogą być wyświetlane w wyniku przyszłego zapytania. Na przykład model GPT-J zapamiętuje co najmniej 1% swoich danych treningowych. Nawet zanonimizowane dane mogą zostać odzyskane poprzez proces znany jako inferencja, w którym narzędzie GenAI trianguluje wiele punktów danych, aby dokładnie odtworzyć oryginalne dane.

W 2023 roku zgłoszono, że pracownicy Amazona nieświadomie udostępnili wrażliwe dane firmy ChatGPT, które następnie wyciekły do użytkowników zewnętrznych. Eksperci szacują, że szkody wyniosły miliony dolarów. Podobny scenariusz miał miejsce w Samsungu w tym samym roku, co skutkowało zakazem używania narzędzi GenAI na urządzeniach należących do firmy. Gdy wrażliwe lub zastrzeżone dane zostaną przekazane narzędziu zewnętrznemu i osadzone w wagach modelu, nie można ich już usunąć. Z tego powodu niezwykle ważne jest, aby informacje takie jak hasła i inne wysoce wrażliwe dane nigdy nie były udostępniane narzędziu AI.

Wprowadzenie uprzedzeń do modeli GenAI jest również poważnym problemem. Szkodliwe uprzedzenia dotyczące rasy, etniczności, płci, statusu społeczno-ekonomicznego i innych pojawiły się w wynikach popularnych narzędzi GenAI. Bezpieczeństwo jest również zagrożone, gdy systemy szkolone na stronniczych danych błędnie identyfikują zagrożenia, pomijają potencjalne zagrożenia i generują fałszywe alarmy. Z tych powodów ważne jest, aby dokładnie analizować i monitorować potencjał uprzedzeń w danych treningowych i podejmowaniu decyzji wspomaganym przez AI.

Sprawdź też: USB power delivery (treść partnera)

Bezpieczeństwo w projektowaniu

Niezależnie od tego, czy jest to narzędzie zewnętrzne, czy projekt wewnętrzny, dokładne badania i jasny plan znacznie zmniejszą ryzyko. Przy opracowywaniu wytycznych dotyczących wdrażania AI, pierwszym krokiem jest dopasowanie przypadku biznesowego do dostępnych narzędzi, pamiętając, że niektóre modele są bardziej odpowiednie do określonych zadań niż inne.

Stosowanie strategii Bezpieczeństwo w projektowaniu od podstaw może zabezpieczyć wdrażanie AI na przyszłość. Te zasady zapewniają, że bezpieczeństwo jest priorytetem przez cały cykl życia produktu AI. Metodologia Bezpieczeństwo w projektowaniu wdraża wiele warstw obrony przed cyberzagrożeniami.

Podczas etapu planowania, wkład zespołu ds. bezpieczeństwa jest kluczowy dla podejścia Bezpieczeństwo w projektowaniu. Zaufanie do dostawców jest również istotne. Ocena dostawców pod kątem wiarygodności i dokładne audytowanie umów, w tym regularne monitorowanie aktualizacji warunków i zasad dostawców, są niezbędne. Ważne jest, aby jakość danych była oceniana pod kątem takich metryk jak dokładność, istotność i kompletność. Skupienie się na bezpieczeństwie przy wdrażaniu i integracji AI zmniejsza ryzyko problemów z zgodnością i kosztownych napraw w przyszłości.

Znaczenie zarządzania danymi

Ramowe zarządzanie danymi pomaga rozwijać relacje robocze między działami w zakresie polityki AI, wdrażania i monitorowania. Mogą również zmniejszyć prawdopodobieństwo kar i naruszeń danych oraz zapewnić bezpieczeństwo marki.

Zespół ds. bezpieczeństwa nie jest jednak jedyną grupą niezbędną do bezpiecznego, efektywnego i przejrzystego wdrażania AI. Dobre praktyki zarządzania danymi obejmują wielu interesariuszy w organizacji, takich jak przedstawiciele działów prawnych, finansowych i zasobów ludzkich (HR). Te najlepsze praktyki sprowadzają się do polityk, które pozwalają pracownikom zarządzać i monitorować dane, gdy przemieszczają się po organizacji, w tym jasne wytyczne dla konkretnych działów, aby dostarczały wkład w proces podejmowania decyzji. Ciągłe szkolenie pracowników na każdym poziomie organizacji również odgrywa ważną rolę. Zarządzanie danymi obejmuje ciągłą ponowną ocenę i pomaga zapobiegać mentalności „ustaw i zapomnij”.

Wymagania dotyczące zgodności z przepisami prawnymi i regulacyjnymi podkreślają wartość dobrego zarządzania danymi. W miarę jak przepisy prawne nadal się rozwijają, przestrzeganie tych ram może zapewnić, że inwestycje w AI są dokonywane na stabilnym fundamencie. Eksperci zalecają, aby firmy poważnie podchodzące do tworzenia lub ulepszania swoich polityk konsultowały się z ramami zarządzania danymi, takimi jak ramy cyberbezpieczeństwa NIST 2.0. Koalicja na rzecz Bezpiecznej AI (CoSAI), Cloud Security Alliance (CSA) i Narodowy Instytut Standaryzacji i Technologii (NIST) oferują dodatkowe zasoby i wytyczne dotyczące zarządzania danymi.

Czytaj też: Włamanie do LastPass powraca, aby prześladować użytkowników

W kierunku bezpieczniejszej AI

Wizjonerscy liderzy biznesowi rozumieją znaczenie właściwego zarządzania danymi przy przyjmowaniu tej szybko zmieniającej się technologii. Wdrożenie strategii SAFER i zdroworozsądkowe podejście do AI i bezpieczeństwa pomoże chronić zasoby firmy i utrzymać prywatność informacji o klientach. Oto jak praktykować strategię SAFER AI:

Zastanów się nad wrażliwością udostępnianych informacji. Każda informacja, którą pracownik udostępnia, może stać się publicznie dostępna. Czy konkurent mógłby uzyskać dostęp do tych informacji? Czy ich udostępnienie mogłoby otworzyć drzwi do cyberataku lub pozwu?

Rozważ koszt organizacyjny udostępniania danych w ramach AI. Czy warto to zrobić dla możliwych korzyści wynikających z wykorzystania mocnych stron AI?

Dopasuj przypadek biznesowy do modelu AI dobrze dopasowanego do zadania. Stosuj dobre zarządzanie danymi, aby komunikować i monitorować wyniki.

Korzystaj z usługi AI tylko wtedy, gdy jest to absolutnie konieczne. Upewnij się, że AI jest najlepszą metodą rozwiązania problemu.

Udostępnianie informacji z e-maili, arkuszy kalkulacyjnych i dzienników serwerów może ujawnić informacje o firmie i klientach. Usuń wszystkie dane osobowe i usuń identyfikatory.

Przyszłość bezpieczeństwa AI

Utrzymywanie bezpieczeństwa na pierwszym planie od samego początku przynosi korzyści, zwłaszcza gdy narzędzia i zagrożenia ewoluują. Bezpieczniejsza AI jest na horyzoncie, gdy więcej użytkowników przestrzega najlepszych praktyk poprzez ramy regulacyjne, międzynarodowe współprace i przypadki użycia zorientowane na bezpieczeństwo. Trend w kierunku niezawodnej, bezpiecznej AI przyniesie korzyści firmom i klientom, podczas gdy te narzędzia nadal wplatają się w tkankę dzisiejszego cyfrowego życia.